【论文解读】DeepSeek Engram

Categories: Paper

目录

概览

尽管混合专家模型(Mixture-of-Experts, MoE)通过条件计算扩展了模型容量,但 Transformer 缺乏原生的知识查找原语,迫使其通过计算低效地模拟检索过程。为了解决这一问题,文章引入条件记忆作为一种互补的稀疏性维度,并通过 Engram 模块实现——该模块对经典的 N-gram 嵌入进行了现代化改造,支持 $O(1)$ 复杂度的查找。通过构建稀疏性分配问题,文章揭示了一个 U 型缩放定律,优化了神经计算(MoE)与静态记忆(Engram)之间的权衡。Engram 的确定性寻址使得可以从主机内存进行运行时预取,其开销可忽略不计。条件记忆将成为下一代稀疏模型不可或缺的建模原语。

代码:https://github.com/deepseek-ai/Engram

一、介绍

稀疏性是智能系统反复出现的设计原则,目前,这一原则主要通过混合专家模型(MoE)实现,它通过条件计算扩展了模型容量。由于能够在不按比例增加计算量的情况下大幅增加模型大小,MoE 已成为前沿模型的事实标准。

尽管这种条件计算范式取得了成功,但语言信号的内在异构性表明仍存在结构优化的空间。具体来说,语言建模包含两个性质不同的子任务:组合推理和知识检索。前者需要深度、动态的计算,而相当一部分文本——如命名实体和程式化模式——是局部的、静态的且高度模式化的。经典 N-gram 模型在捕捉此类局部依赖性方面的有效性表明,这些规律性可以被自然地表示为计算成本低廉的查找操作。由于标准 Transformer 缺乏原生的知识查找原语,当前的大语言模型被迫通过计算模拟检索过程。例如,解析一个常见的多 token 实体需要依赖多个早期注意力层和前馈网络层。这个过程本质上相当于对一个静态查找表进行昂贵的运行时重建,将宝贵的序列深度浪费在本可用于更高层次推理的琐碎操作上。

为使模型架构与这种语言二元性对齐,文章提出一种互补的稀疏性维度:条件记忆(conditional memory)。条件计算通过稀疏激活参数来处理动态逻辑,而条件记忆则依赖稀疏查找操作来检索固定知识的静态嵌入。本文提出 Engram,这是一种基于经典 N-gram 结构但进行现代化改造适配(如分词器压缩、多头哈希、上下文感知门控和多分支集成)的条件记忆模块。Engram 将主干网络从早期层重构静态知识的任务中解放出来,从而增加了可用于复杂推理的有效深度。此外,通过将局部依赖性委托给查找操作,Engram 释放了注意力容量以专注于全局上下文,从而在长上下文场景中实现了卓越的性能。

二、架构

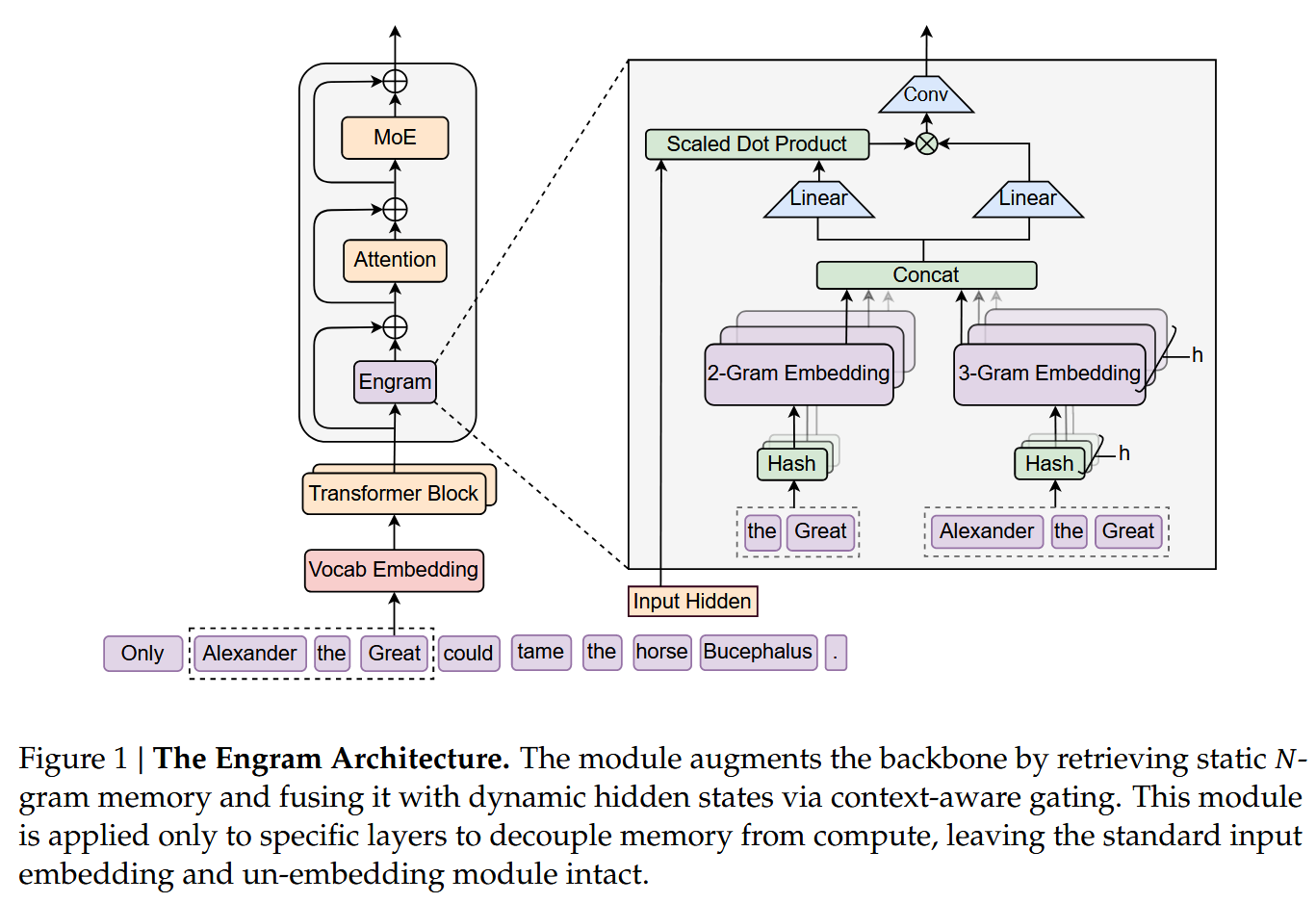

如下图所示,旨在通过从结构上分离静态模式存储与动态计算来增强 Transformer 主干网络。形式上,给定输入序列 $X = ( x _ { 1 } , \ldots , x _ { T } )$ 和第 $\ell$ 层的隐藏状态 $\mathbf { H } ^ { ( \ell ) } \in \mathbb { R } ^ { T \times d }$,该模块在每个位置 $t$ 执行两个功能:检索和融合。首先,提取并压缩后缀 N-gram,通过哈希确定性检索静态嵌入向量。这些检索到的嵌入通过当前隐藏状态动态调制,并通过轻量级卷积进行细化。

(一)通过哈希 N-gram 实现稀疏检索

第一阶段将局部上下文映射到静态记忆条目,涉及到分词器压缩和通过确定性哈希检索 embedding。

分词器压缩

虽然 N-gram 模型通常直接在分词器输出上操作,但标准子词分词器优先考虑无损重建,通常会为语义等价的术语分配不同的 ID(如Apple vs. ␣apple)。为了最大化语义密度,文章实现了一个词汇表投影层。具体来说,预先计算一个满射函数 $\mathcal { P } : V \rightarrow V ^ { \prime }$,该函数基于标准化文本等价性(使用 NFKC、小写转换等)将原始 token ID 转换为规范标识符。实践中,该过程对于 128k 分词器实现了 23% 的有效词汇量缩减。形式上,对于位置 $t$ 处的 token,将其原始 ID $x _ { t }$ 映射到规范 ID $x _ { t } ^ { \prime } = \mathcal { P } ( x _ { t } )$ 以形成后缀 N-gram $g _ { t , n } = ( x _ { t - n + 1 } ^ { \prime } , \dots , x _ { t } ^ { \prime } )$。

多头哈希

直接参数化所有可能 N-gram 的组合空间是不可行的,因此采用基于哈希的方法,将巨大的 N-gram 空间,压到一个固定大小的哈希空间里。为缓解冲突,为每个 N-gram 阶数 $n$ 使用 $K$ 个不同的哈希头。每个头 $k$ 通过确定性函数 $\varphi_{n,k}$ 将压缩后的上下文映射到嵌入表 $\mathbf{E}_{n,k}$(大小为质数 $M_{n,k}$)内的一个索引:

\(\begin{equation} z _ {t, n, k} \triangleq \varphi_ {n, k} \left(g _ {t, n}\right), \quad \mathbf {e} _ {t, n, k} = \mathbf {E} _ {n, k} \left[ z _ {t, n, k} \right] \end{equation}\) 实践中,$\varphi_{n,k}$ 实现为轻量级的乘法异或哈希。通过拼接所有检索到的嵌入来构建最终的记忆向量 $\mathbf{e}_t \in \mathbb{R}^{d_{\mathrm{mem} }}$: \(\begin{equation} \mathbf{e}_t \triangleq \mathop{\|}_{n=2}^{N} \mathop{\|}_{k=1}^{K} \mathbf{e}_{t,n,k} \end{equation}\)

(二)上下文感知门控

检索到的嵌入 $\mathbf { e } _ { t }$ 作为上下文无关的先验。然而,由于是静态的,它们本身缺乏上下文适应性,并可能因哈希冲突或多义词而引入噪声。为了增强表达能力并解决这种歧义性,采用受注意力机制启发的上下文感知门控机制。具体而言,我们利用当前隐藏状态 $\mathbf { h } _ { t }$ (已通过先前的注意力层聚合了全局上下文)作为动态查询,而检索到的记忆 $\mathbf { e } _ { t }$ 则作为键(Key)和值(Value)的来源:

\(\begin{equation} \mathbf{k}_t = \mathbf{W}_K \mathbf{e}_t, \quad \mathbf{v}_t = \mathbf{W}_V \mathbf{e}_t \end{equation}\) 其中 $\mathbf{W}_K, \mathbf{W}_V$ 是可学习的投影矩阵。为确保梯度稳定性,在计算标量门控 $\alpha_t \in (0, 1)$ 之前对查询和键应用 RMSNorm: \(\begin{equation} \alpha_t = \sigma \left(\frac{\operatorname{RMSNorm}(\mathbf{h}_t)^\top \operatorname{RMSNorm}(\mathbf{k}_t)}{\sqrt{d} }\right) \end{equation}\) 门控输出定义为 $\tilde{\mathbf{v} }_t = \alpha_t \cdot \mathbf{v}_t$。该设计能够强制语义对齐:如果检索到的记忆 $\mathbf{e}_t$ 与当前上下文 $\mathbf{h}_t$ 矛盾,则门控 $\alpha_t$ 趋向于零,有效抑制噪声。

最后,为扩展感受野并增强模型的非线性,引入一个短的深度因果卷积。令 $\tilde{\mathbf{V} } \in \mathbb{R}^{T \times d}$ 表示经过门控的 values 序列,使用卷积核 $w$(设为4)、膨胀率 $\delta$(设为最大 N-gram 阶数)和 SiLU 激活函数,最终输出 $\mathbf{Y}$ 计算为:

\(\begin{equation} \mathbf{Y} = \operatorname{SiLU}\left(\operatorname{Conv1D}(\operatorname{RMSNorm}(\tilde{\mathbf{V} }))\right) + \tilde{\mathbf{V} } \end{equation}\) Engram 模块通过残差连接集成到骨干网络中:$\mathbf{H}^{(\ell)} \leftarrow \mathbf{H}^{(\ell)} + \mathbf{Y}$,随后是标准的注意力和 MoE。

(三)与多分支架构的集成

文章采用里先进的多分支架构作为默认骨干网络,而非标准单流连接。该架构的一个决定性特征是将残差流扩展为 $M$ 个并行分支,其中信息流由可学习的连接权重调制。

虽然 Engram 模块本质上是拓扑无关的,但将其适配到多分支框架需要结构优化以平衡效率和表达能力。具体而言,文章实现了一种参数共享策略:单个稀疏嵌入表和一个值投影矩阵 $\mathbf{W}_V$ 在所有 $M$ 个分支间共享,而 $M$ 个不同的键投影矩阵 ${\mathbf{W}_K^{(m)}}_{m=1}^M$ 用于实现分支特定的门控行为。对于具有隐藏状态 $\mathbf{h}_t^{(m)}$ 的第 $m$ 个分支,分支特定的门控信号计算为: \(\begin{equation} \alpha_t^{(m)} = \sigma \left(\frac{\operatorname{RMSNorm}(\mathbf{h}_t^{(m)})^\top \operatorname{RMSNorm}(\mathbf{W}_K^{(m)} \mathbf{e}_t)}{\sqrt{d} }\right) \end{equation}\) 随后,这些独立门控作用于共享的 Value 向量,从而对检索到的记忆进行调制:$\mathbf{u}_t^{(m)} = \alpha_t^{(m)} \cdot (\mathbf{W}_V \mathbf{e}_t)$。这种设计允许将线性投影(一个 $\mathbf { W } _ { V }$ 和 $M$ 个不同的 $\mathbf { W } _ { K } ^ { ( m ) }$)融合成一个单一的稠密 FP8 矩阵乘法,从而最大化现代 GPU 的计算利用率。除非另有说明,文章所有实验都使用与 Manifold-Constrained Hyper-Connections $(M = 4)$ 的集成。

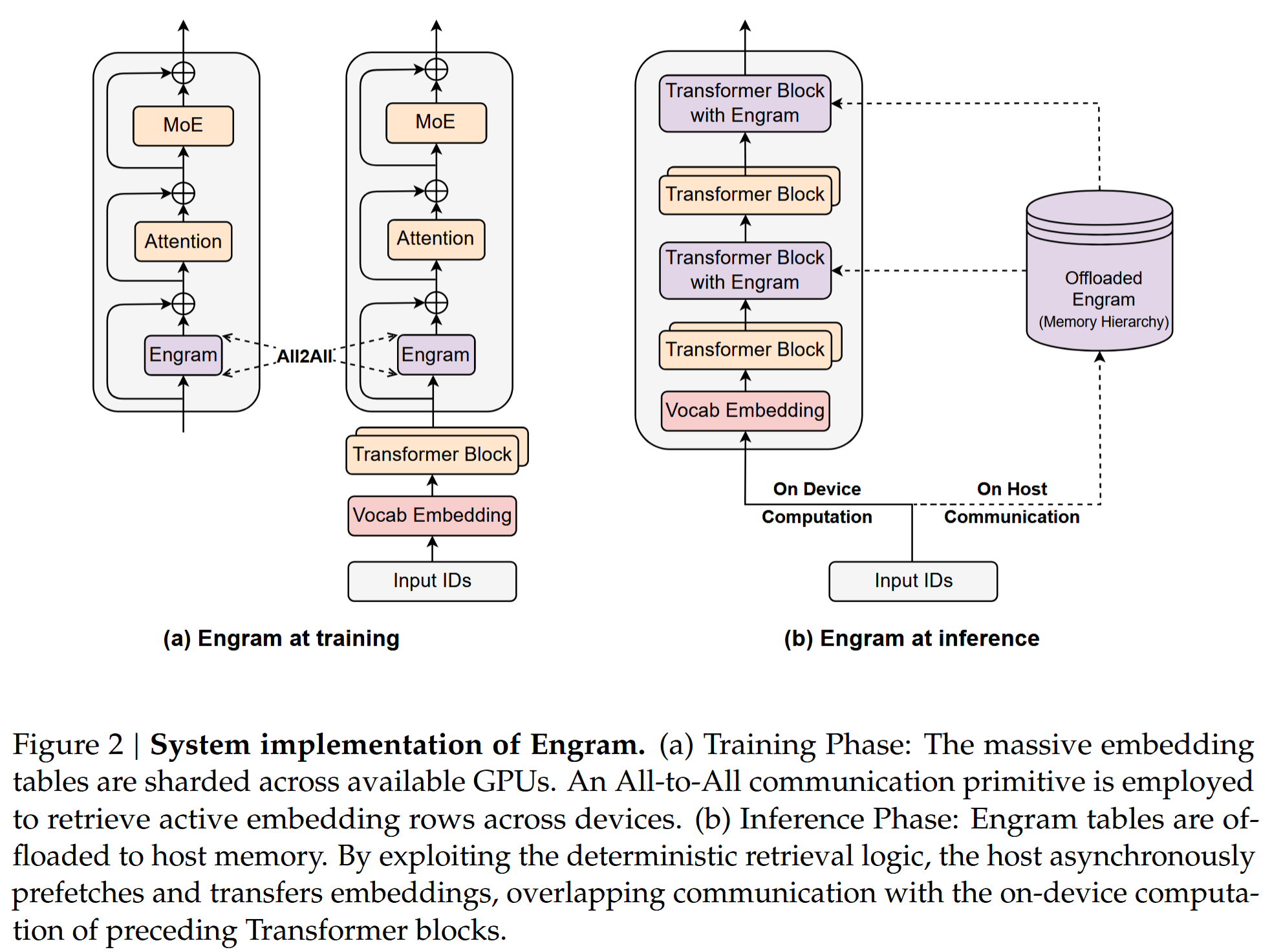

(四)系统效率:解耦计算与记忆

记忆增强的模型 scaling 通常受限于 GPU 高带宽内存(HBM)的有限容量。然而,Engram 的确定性检索机制天然支持将参数存储与计算资源解耦。与依赖运行时隐藏状态进行动态路由的 MoE 不同,Engram 的检索索引仅依赖于输入 token 序列。这种可预测性有助于为训练和推理制定专门的优化策略,如下图所示。

训练期间,为适配大规模嵌入表,采用标准模型并行策略,将嵌入表分片存储至可用显卡上。使用前向传播中的 All-to-All 通信原语收集活跃行,并在反向传播中分发梯度,使总记忆容量能够随加速器数量线性扩展。

推理期间,这种确定性特性使得预取与重叠策略成为可能。由于记忆索引在前向传播之前就已知,系统可以通过 PCIe 从充裕的主机内存中异步检索嵌入。为了有效地掩盖通信延迟,Engram 模块被放置在主干网络的特定层,利用前面层的计算作为缓冲区来防止 GPU 停滞。这需要一种硬件-算法协同设计策略:虽然将 Engram 放置得更深可以延长用于隐藏延迟的计算窗口,但消融实验表明,建模性能更倾向于早期干预以卸载局部模式重建。因此,最优放置必须同时满足建模和系统延迟的约束。

此外,自然语言 N-gram 本质上遵循齐普夫分布,其中一小部分模式占据了绝大多数记忆访问。这种统计特性激励了多级缓存层次结构:频繁访问的嵌入可以缓存在更快的存储层(如 GPU HBM 或主机 DRAM),而罕见模式的长尾则驻留在较慢的高容量介质(如 NVMe SSD)中。这种分层允许 Engram 以最小的有效延迟影响扩展到海量记忆容量。

三、缩放定律与稀疏性分配

Engram 作为条件记忆(conditional memory)的一种实例,在结构上是对 MoE 专家所提供的条件计算(conditional computation)的补充。因此,有以下两个问题值得研究:

- 有限约束下的分配。当总参数和训练计算固定时(等参数和等 FLOPs),我们应该如何在 MoE 专家和 Engram 嵌入之间分配稀疏容量?

- 无限记忆机制。考虑到 Engram 具有固定的 $O(1)$ 开销,如果放宽或积极扩展记忆预算,Engram 本身会表现出怎样的扩展行为?

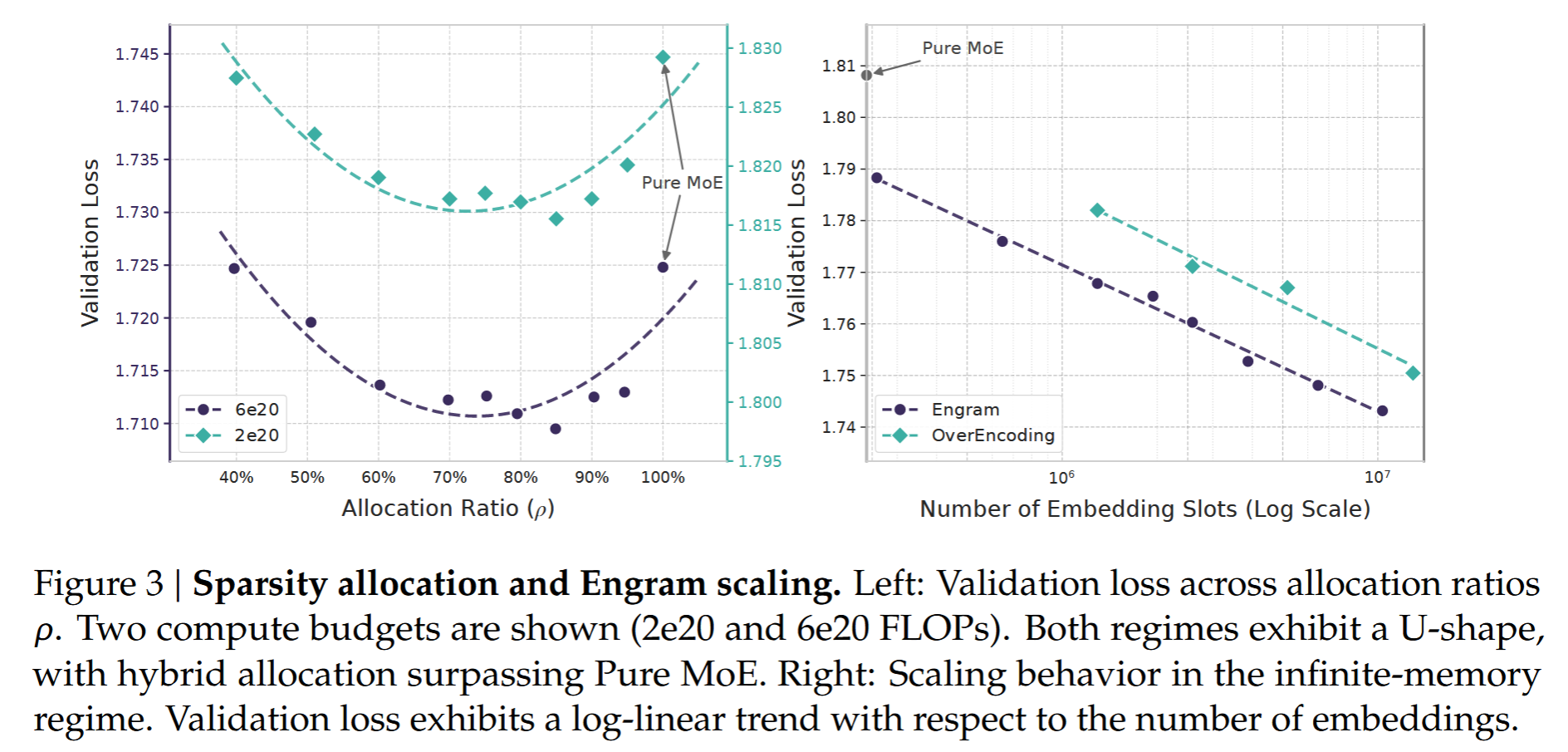

(一)MoE与Engram之间的最优分配比例

计算匹配公式:使用三个参数指标分析权衡:

- $P_{\mathrm{tot} }$:总可训练参数,不包括词汇嵌入和 LM Head。

- $P_{\mathrm{act} }$:每个 token 激活的参数,该数量决定训练成本(浮点运算量)。

- $P_{\mathrm{sparse} } \triangleq P_{\mathrm{tot} } - P_{\mathrm{act} }$:非激活参数,代表可用于扩展模型规模而不增加计算成本的“免费”参数预算(如未选中的专家或未检索的嵌入)。

我们在每个浮点运算量预算内保持 $P_{\mathrm{tot} }$ 和 $P_{\mathrm{act} }$ 固定,使模型具有相同数量的参数和相同的每 token 浮点运算量。对于 MoE,$P_{\mathrm{act} }$ 由 top-k 选中的专家决定,而非选中专家的参数贡献给 $P_{\mathrm{sparse} }$。对于 Engram,每个 token 仅检索常数数量的槽位,因此扩展嵌入槽位数量会增加 $P_{\mathrm{tot} }$ 而不增加每 token 浮点运算量。

分配比例:定义 $\rho \in [0, 1]$ 为分配给 MoE 专家容量的非激活参数预算比例: \(\begin{equation} P_{\mathrm{MoE} }^{(\text{sparse})} = \rho P_{\text{sparse} }, \quad P_{\text{Engram} } = (1 - \rho) P_{\text{sparse} } \end{equation}\)

直观上:

- $\rho = 1$ 对应纯 MoE 模型(所有非激活参数都是路由专家)。

- $\rho < 1$ 减少路由专家数量,并将释放的参数重新分配给 Engram 嵌入槽位。

实验协议:在两个计算机制下评估这种权衡,并保持恒定的稀疏比 $P_{\mathrm{tot} }/P_{\mathrm{act} } \approx 10$:

- $C = 2 \times 10^{20}$ 浮点运算量:$P_{\mathrm{tot} } \approx 5.7\mathrm{B}$,$P_{\mathrm{act} } = 568\mathrm{M}$。基线($\rho = 1$)共有 106 个专家。

- $C = 6 \times 10^{20}$ 浮点运算量:$P_{\mathrm{tot} } \approx 9.9\mathrm{B}$,$P_{\mathrm{act} } = 993\mathrm{M}$。基线($\rho = 1$)共有 99 个专家。

对于不同的 $\rho$,仅通过调整路由专家数量和 Engram 嵌入槽位数量来构建相应模型。所有运行使用相同的训练流程和优化超参数。

结果与分析:图 3(左)揭示了验证损失与分配比例 $\rho$ 之间一致的 U 型关系。值得注意的是,即使将 MoE 分配减少到仅 $\rho \approx 40\%$(即5.7B 模型共 46 个专家,9.9B 模型共 43 个专家),Engram 模型也能实现与纯 MoE 基线($\rho = 100\%$)相当的性能。此外,纯 MoE 基线被证明是次优的:将约 20%-25% 的稀疏参数预算重新分配给 Engram 可获得最佳性能。定量上,在 10B 参数机制下($C = 6 \times 10^{20}$),验证损失从 1.7248($\rho = 100\%$时)改善到 1.7109($\Delta = 0.0139$),此时有最优 $\rho \approx 80\%$ 。关键在于,该最优值的位置在不同机制间是稳定的($\rho \approx 75\%-80\%$),这表明在固定稀疏度下,于所有研究尺度中均存在稳健的分配偏好。观察到的 U 型曲线确认了两种模块之间的结构互补性:

- MoE 主导 ($\rho \rightarrow 100\%$):模型缺乏用于静态模式的专用记忆,迫使其通过深度和计算低效地重建它们。

- Engram 主导 ($\rho \rightarrow 0\%$):模型失去条件计算容量,损害需要动态、上下文相关推理的任务;在此机制下,记忆无法替代计算。

(二)无限记忆机制下的 Engram

上一节中,我们在固定参数预算下优化了分配,现在来探索互补设置:积极的记忆扩展。因为 Engram 具有如前所述的解耦存储与计算的独特能力。

实验协议:使用一个固定的 MoE 主干网络,具有 $P _ { \mathrm { t o t } } \approx 3 \mathrm { B }$ 和 $P _ { \mathrm { a c t } } = 5 6 8 \mathrm { M }$,训练了100B 个 token 以确保收敛。在此主干网络之上,附加一个 Engram 表,并将槽位数量 $N$ 从 $2 . 5 8 \times 1 0 ^ { 5 }$ 扩展到 $1 . 0 \times 1 0 ^ { 7 }$(总共增加约 13B 参数)。对于基线,与 OverEncoding 进行比较,它通过与词表平均来集成 N-gram 嵌入。

结果如图 3(右)所示,扩展记忆槽位的数量带来了清晰且持续的验证损失改善。在所探索的范围内,曲线遵循严格的幂律(在对数空间中呈线性),表明 Engram 提供了一个可预测的缩放旋钮:更大的记忆容量持续带来收益,而无需额外的计算。这些结果验证了条件记忆作为一种独特的、可扩展的稀疏容量轴,与 MoE 的条件计算相辅相成。

四、大规模预训练

基于提出的 Engram 架构和推出的经验分配规律,将 Engram 扩展到几十亿参数以验证其在真实世界语言模型预训练中的有效性。具体而言,训练四个模型:(1) Dense-4B(4.1B 总参数),(2) MoE-27B(26.7B 总参数),(3) Engram-27B(26.7B 总参数),和(4) Engram-40B(39.5B 总参数)。所有模型使用相同的数据训练流程(相同的 token 预算和顺序),并在激活参数数量上严格匹配。

(一)实验设置

训练数据与模型配置:所有模型在 262B tokens 的语料库上预训练,使用 DeepSeek-V3 的分词器,词表大小为 128k。使用 30 个 transformer block,hidden size 为 2560。每个 block 使用具有 32 个头的 MLA,通过扩展率为 4 的 mHC 连接至 FFN,所有模型使用 Muon 优化器。总共实例化四个不同的模型:

- Dense-4B 作为基线模型。它使用上述骨干架构,在每个 block 中集成标准密集 FFN。

- MoE-27B 将标准密集 FFN 替换为 DeepSeekMoE 模块。配置为 72 个路由专家和 2 个共享专家(每个 token 激活 top-k=6 个路由专家),该模型扩展到 26.7B 总参数,同时保持与 Dense-4B 相同的激活参数。

- Engram-27B 严格从 MoE-27B 架构派生以确保公平比较。将路由专家数量从 72 减少到 55,并将释放的参数重新分配给 5.7B 参数的嵌入模块($\rho = 74.3\%$),保持总模型大小恒定为 26.7B。关于 Engram 配置,在第 2 层和第 15 层实例化该模块,设置最大N-gram 大小为 3,头数为 8,维度为 1280。对于优化,嵌入参数使用 Adam 优化器,学习率缩放 5 倍且无权重衰减,而卷积参数初始化为零以在训练开始时严格保持恒等映射。

- Engram-40B 保留与 Engram-27B 相同的骨干和计算预算,但将稀疏嵌入模块扩展到 18.5B 参数(总计 39.5B 参数)。该模型旨在研究 Engram 的 sacling 特性。

评估协议:在涵盖语言建模、知识、推理、阅读理解和代码/数学的多样化基准套件上评估模型。

(二)实验结果

在相同的训练计算预算下,所有三种稀疏变体(MoE-27B、Engram-27B/40B)在所有基准上均显著优于等浮点运算量的 Dense-4B 基线。

Engram-27B 在等参数量和等浮点运算量的 MoE-27B 基线上持续改进。有趣的是,这些增益不仅限于知识密集型任务(如 MMLU: +3.0,MMLU-Pro: +1.8,CMMLU: +4.0),在通用推理领域(如 BBH: +5.0,ARC-Challenge: +3.7,DROP: +3.3)以及代码和数学推理(如 HumanEval: +3.0,MBPP: +1.6,GSM8K: +2.2,MATH: +2.4)观察到了更显著的提升。这证明了先前的假设:引入专用的知识查找原语提高了表示效率,超出了将整个稀疏预算分配给条件计算所能达到的效果。

最后,扩展到 Engram-40B 进一步降低了预训练损失,并在大多数基准上提升了性能。虽然它尚未在每个任务上严格优于 Engram-27B,但这可能是训练不足所导致的。在训练结束时可以观察到,Engram-40B 与基线之间的训练损失差距仍在继续扩大,这表明在当前 token 预算内,扩展的记忆容量尚未完全饱和。

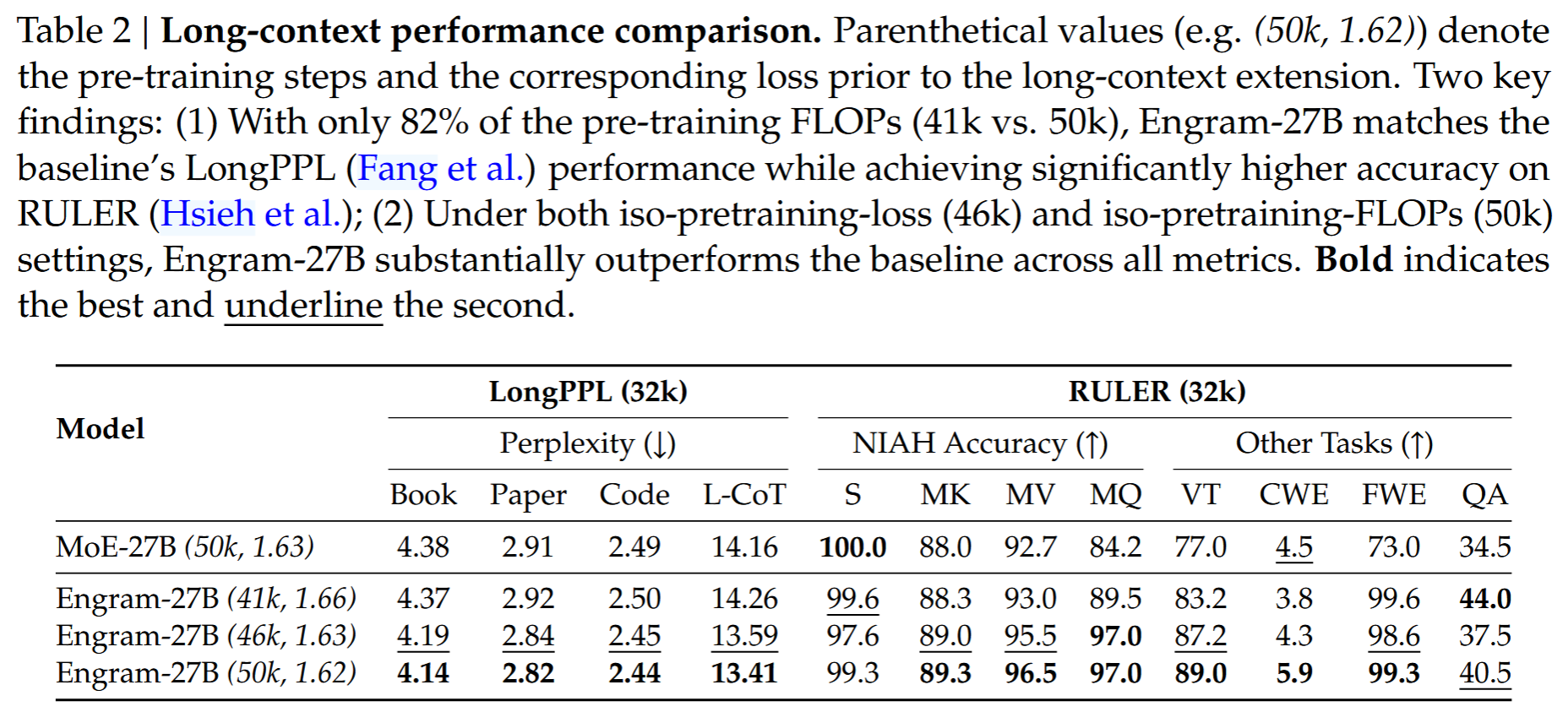

五、长上下文训练

Engram 架构的核心假设之一是:通过将局部依赖建模卸载给静态查找表,可以为注意力机制保留更多容量来处理全局上下文。本章通过严谨的长上下文扩展训练实验,实证验证了这一结构优势。

(一)实验设置

- 训练策略:采用与 DeepSeek-V3 类似的上下文扩展方案。预训练完成后,使用 YaRN 方法进行上下文窗口扩展,在 32K token 上下文窗口上训练 5000 步(30B tokens 高质量长上下文数据)。YaRN 超参数:$s = 1 0 , \alpha = 1 , \beta = 3 2$,缩放因子 $f = 0 . 7 0 7$。

- 模型对比:设置了四种配置进行对比

- MoE-27B (50k):完全预训练的 MoE 基线。

- Engram-27B (50k):完全预训练的 Engram 模型。

- Engram-27B (46k):预训练第 46k 步的检查点,其预训练损失与 MoE-27B (50k) 完全相同,构成等损失对照。确保上下文扩展期间的任何性能差异都可归因于架构而非模型的起始质量。

- Engram-27B (41k):更早期检查点,测试极端算力节省下的表现。

- 评估基准:LongPPL(长书籍、论文、代码仓库、长 CoT 轨迹)和 RULER(8 大类 14 子任务,包括多种 Needle-in-a-Haystack 变体、多跳变量追踪、问答等)。

(二)实验结果

- 超越注意力机制的长上下文能力

虽然注意力机制和位置编码为上下文处理提供了结构基础,但实验结果表明,长上下文性能并不仅仅由架构先验决定,Engram 从 41k → 50k 的过程中长上下文性能单调提升,这表明长上下文性能与基础模型的通用建模能力内在相关。因此,严格的架构比较必须通过对齐基础模型损失来控制这一混杂变量,而不仅仅是比对训练步数。

- 受控设置下的架构优越性

在上述原则指导下,将 Engram 与 MoE 基线进行比较。在控制基础能力相同时,Engram 模块的效率增益变得显而易见:

- 等损失设置(46k vs. 基线):此设置严格隔离了架构效率。当比较 Engram-27B(46k)与完全训练的 MoE-27B(50k)时(这两个模型在预训练损失上对齐),Engram 展示了显著的增益。

- 等 FLOPs 设置(50k vs. 基线):在标准的等计算预算下,Engram-27B(50k)进一步拉大了差距,在所有指标上确立了最高性能。

- 极端设置(≈82%计算量):即使是提前停止的 Engram-27B(41k),在与完全训练的 MoE-27B(50k)相比时仍然保持高度竞争力。它在 LongPPL 上与基线持平,并在 RULER 上超越基线,突显了 Engram 架构的内在优越性。

六、分析

这里仅简要介绍原文分析的几点结论:

- 通过显式地访问外部知识,Engram 减少了所需的计算步骤,从而在网络层次结构的更早阶段达到高置信度、有效的预测。

- 通过显式查找绕过早期特征组合,Engram 在功能上等同于增加了模型的有效深度。

- Engram 的注入位置:早期注入:可以在骨干网络耗费计算深度之前,就卸载掉局部模式重建的任务,符合Transformer层次化处理的自然规律。晚期注入:此时隐藏状态已经通过注意力聚合了更丰富的全局上下文,能为门控机制提供更精确的查询信号。因此,最优放置需要平衡(i)早期卸载静态局部模式和(ii)利用更强的上下文查询进行后期门控。

- 对性能影响最大的三个组件是:

- 多分支特异性融合:针对 MoE 中不同专家分支进行独立的记忆融合。

- 上下文感知门控:动态调节检索记忆的融入强度。

- 分词器压缩:对 N-gram 进行编码以减少存储开销。

- 骨干 Transformer 专注于动态的、与上下文相关的组合与推理,而静态的、事实性的知识则卸载到 Engram 这个可扩展的、高效的记忆模块中。

- Engram 的算法设计(确定性寻址)与系统优化(预取、计算-通信重叠)相结合,能够实现参数量与计算量的真正解耦。我们可以构建参数极大但推理成本几乎不变的模型,这打破了传统 MoE 在参数量增长时面临的通信和路由开销瓶颈。

七、总结

本文引入了条件记忆作为对当前流行的条件计算范式(MoE)的互补稀疏性轴,旨在解决通过动态计算模拟知识检索的低效问题。通过 Engram 模块实例化了这一概念,该模块将经典的 N-gram 进行现代化改造,以实现静态模式的可扩展、常数时间查找。

通过构建稀疏性分配问题,文章揭示了一个 U 型缩放定律,证明在 MoE 专家和 Engram 记忆之间混合分配稀疏容量严格优于纯 MoE 基线。在此定律指导下,将 Engram 扩展到 27B 参数,在不同领域实现了卓越的性能。值得注意的是,虽然记忆模块直观上有助于知识检索,但在通用推理、代码和数学领域观察到了更大的提升。

机理分析表明,Engram 通过将主干网络从早期层的静态重建任务中解放出来,有效地“加深”了网络,从而释放了注意力容量,使其能够专注于全局上下文和复杂推理。这种架构上的转变转化为长上下文能力的实质性改进,LongPPL 和 RULER上 的性能提升证明了这一点。最后,Engram 倡导将基础设施感知的效率作为一等设计原则。其确定性寻址允许存储与计算解耦,使得将海量参数表卸载到主机内存成为可能,且推理开销可忽略不计。条件记忆或将成为下一代稀疏模型不可或缺的建模原语。